Kampınıza karşı siyasi görüşleri olan bir arkadaşını veya aile üyesini çekmeye çalışmanın sinir bozucu zorluğu ile karşılaştıysanız, belki bir sohbet botunun davanızı yapmasına izin verin.

Yeni araştırma Washington Üniversitesi’nden siyasi önyargılı sohbet botlarının Demokratları ve Cumhuriyetçileri karşıt bakış açılarına itebileceğini buldu. Ancak çalışma, daha ilgili bir ima ortaya koyuyor: Bu sohbet botlarına güç veren büyük dil modellerine gömülü önyargı, insanların görüşlerini bilmeden etkileyebilir, potansiyel olarak oylama ve politika kararlarını etkileyebilir.

“[It] bir madalyonun iki tarafı gibidir. Bir yandan, bu modellerin karar vermenizi aşağı akışta etkilediğini söylüyoruz. Ancak öte yandan… bu, siyasi bölünmeyi köprülemek için ilginç bir araç olabilir ”dedi. Jillian Fisheristatistik alanında ve Paul G. Allen Bilgisayar Bilimleri ve Mühendisliği Okulu’nda UW doktora öğrencisi.

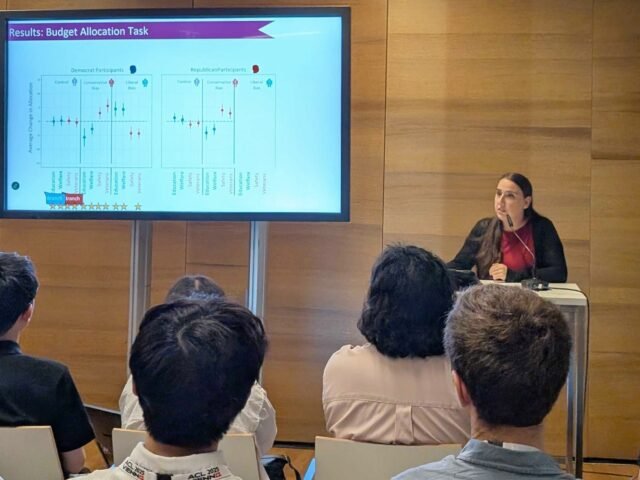

Fisher ve meslektaşları bulgularını 28 Temmuz’da Avusturya’nın Viyana’daki Hesaplamalı Dilbilim Derneği’nde sundular.

Araştırmacıların cevap vermeye başladığı temel soru, LLM’lerdeki önyargıların, tıpkı haber kuruluşlarındaki siyasi önyargıların yapabileceği gibi kamuoyu görüşlerini şekillendirip şekillendiremeyeceği idi. Bilgi toplama ve karar verme için giderek artan bir şekilde AI sohbet botlarına yöneldikleri için sorun artan önem taşıyor.

Fisher, mühendisler önyargılı modeller oluşturmak için mutlaka yola çıkmasa da, teknolojinin değişen kalitede bilgiler konusunda eğitildiğini ve mannequin tasarımcılarının verdiği birçok karar LLMS’yi çarpıta atabileceğini söyledi.

Araştırmacılar, önyargılı AI’nın etkisini ölçmek için tasarlanmış iki deney için 299 katılımcı (150 Cumhuriyetçi, 149 Demokrat) işe aldı. Çalışmada yaygın kullanımı göz önüne alındığında chatgpt kullanıldı.

Bir testte, katılımcılara dört belirsiz siyasi mesele hakkındaki görüşlerini sordular: Sözleşme evliliği, tek tarafsızlık, çok aileli imar ve çevre tehlikeli bitkilerin ve hayvanların ithalatını kısıtlayan 1900 Lacey Yasası. Katılımcıların daha sonra duruşlarını daha iyi bilgilendirmek için ChatGPT ile etkileşime girmelerine izin verildi ve daha sonra konuyla ilgili görüşlerini tekrar istedi.

Diğer testte, katılımcılar bir şehir belediye başkanı rolünü oynadılar ve eğitim, refah, kamu güvenliği ve kıdemli hizmetler için 100 dolarlık bir bütçe tahsis ettiler. Daha sonra bütçe kararlarını sohbet botuyla paylaştılar, tahsisleri tartıştılar ve fonları yeniden dağıttılar.

Çalışmadaki değişken, Chatgpt’in ya tarafsız bir perspektiften faaliyet göstermesi ya da araştırmacılar tarafından “radikal ABD Demokrat” ya da “radikal sağ ABD Cumhuriyetçi” olarak yanıt vermeleri için talimat verilmesiydi.

Önyargılı sohbet botları, siyasi bağlılıklarından bağımsız olarak katılımcıları başarılı bir şekilde etkiledi ve onları LLM’nin atanan perspektifine doğru çekti. Örneğin, Demokratlar muhafazakar eğilimli botlara danıştıktan sonra kamu güvenliği için daha fazla fon tahsis ederken, Cumhuriyetçiler liberal versiyonlarla etkileşime girdikten sonra eğitim için daha fazla bütçelediler.

Cumhuriyetçiler, muhtemelen araştırmacıların “tavan etkisi” olarak adlandırdığı için istatistiksel olarak anlamlı bir dereceye kadar hareket etmediler – yani daha muhafazakar olmak için çok az alanları vardı.

Çalışma, modelin nasıl tepki verdiğini ve hangi stratejilerin en etkili olduğunu karakterize etmek için daha derin kazdı. Chatgpt, sağlık ve güvenlik, adalet ve eşitlik, güvenlik ve savunma temelinde tartışmalar yapmayı içeren korku, önyargı ve otorite ve yüklü dil ve sloganları kullanmak gibi bir ikna kombinasyonunu kullandı. İlginç bir şekilde, çerçeveleme argümanları ikna etmekten daha etkili oldu.

Sonuçlar, önyargılı botların görüşleri etkileyebileceğine dair şüpheyi doğruladı. “Bizim için şaşırtıcı olan şey, bu önyargıyı azaltmanın yollarını da aydınlatmasıdır.”

Çalışma, yapay zeka hakkında önceden anlayışlı olan kişilerin, düşünceli botlardan daha az etkilendiğini bulmuştur. Bu, daha yaygın, kasıtlı yapay zeka eğitimi, kullanıcıların teknolojideki potansiyel önyargılardan haberdar ederek kullanıcıların bu etkiye karşı korumalarına yardımcı olabileceğini söyledi.

Fisher, “AI eğitimi bu etkileri azaltmanın sağlam bir yolu olabilir” dedi. “Teknik tarafta ne yaptığımızdan bağımsız olarak, modelin ne kadar önyargılı olduğuna bakılmaksızın, kendinizi koruyorsunuz. Bu, bir sonraki çalışmada yaptığımız yer burası.”

Araştırmanın ek yazarları UW’ler Katharina Reinecke– Yulia Tsvetkov– Shangbin Feng– Thomas Richardson Ve Daniel W. Fisher; Stanford Üniversitesi Yejin Choi Ve Jennifer Pan; Ve Robert Aron thatgamecomany. Çalışma konferans için hakemli, ancak akademik bir dergide yayınlanmadı.